前言和叠甲

本教程只是共享给朋友方便拉人入门的,如果你有更好的解决方案,按你说的来。

什么是VibeCoding?

很简单:你让AI开始写代码就行,比如说:

- 你把你的需求和期望结果和AI说清楚,然后网页版AI返回了代码,你粘贴进去运行用。

- 调用类似于Cursor / TRAE / Antigravity 这类的AI编程IDE,或者是Jetbrains / VsCode的AI扩展,对话形式写代码。

- 调用 CodeX / ClaudeCode(下称CC) / GeminiCLI / OpenCode这类AI编程CLI。

虽然都是VibeCoding,不过后两种方式更爽一些,主要原因是相对于IDE/CLI,复制粘贴代码本身就是个工作量,而IDE/CLI会在生成代码的时候调用各种skill检查代码确保不会犯一些类型、括号这类的低级错误,但网页不会。另外CLI / IDE允许AI访问你的整个项目,网页呢本来上下文就有限,还没那么高的权限。

故通过CLI / IDE去VibeCoding是一个更好的选择,网页更加适合聊天。

什么是Agent

LLM是不能直接操作你的项目代码的,他需要一个中介,这个中介就是Agent。

一方面中介通过prompt工程告诉LLM如何增删改查文件,另一方面LLM通过返回来控制Agent,实现帮你写代码。

Agent可以囊括很多东西,比如Cursor TRAE这些以AI编程为卖点的IDE其实是内置了Agent。CodeX、CC、GeminiCLI、OpenCode则是把AGENT上做了一个cli程序,方便你在任何终端调用。

降低期望

AI不是万能的,爆论是:AI能让前端干后端的活,后端能干前端的活,但不能把一个完全不懂的人变成资深工程师。

我自己在工作过程中也经常使用大模型,以生成一个简单的python代码为例,以下两种不同的问法预期结果也会不一样:

请帮我生成一段Python程序,这个程序用socket库建立一个TCP服务端,服务端接收来自客户端的数据并原样返回。 服务端监听在0.0.0.0:23333 支持多个客户端同时连接

生成一个程序,作为服务端支持多个客户端连接

效果肯定是不一样的,后者都不一定能确保输出是python程序。目前大部分LLM还不会一句一句问你(会的话也显得效率很低下)。举这个例子的意思是:你仍然需要有一定的技术功底才能更好的驯服LLM为你服务。

另外不要太指望LLM的世界知识库,就算它什么都懂,训练语料集也不一定是最新的。

所以比如说你在用的时候需要传递更多的信息,比如说你要使用bootstrapvuenext这个库弄个简单的页面出来,最好把文档url也传递给LLM,这样它才能更好的给你当牛马。类似于你分活给下属,除了分活也要交代活的背景,怎么样更好的完成活。

还有个要提到的,饭要一口一口吃,程序也是一行代码一行代码写。用AI也是一样,一个需求一个需求提,先搭框架再填内容。一蹴而就容易失败,完事了改又要token量。

适合AI干的活

舒适区:

- 根据已有代码写文档

- 把你老项目review一遍,提一些意见,然后让它一点一点改。

- Python这种比较热门的语言

不舒适区:

- 干你能力外的事情

- 啥文档不给,让他弄些很冷门的活,比如让他二开一个很小众的产品。

- RUST,资料不多

订阅和成本

前言叠了甲,接下来来讨论下花钱的问题。钱有两种花法,一种是订阅制,一种是按量计费。综合来说订阅制比较稳,按量计费的话空子比较多。我个人的配置是这样的:

Github Copilot Pro (10USD/月) + Gemini Pro (家庭组 人均30左右/月)

为什么会有成本呢?因为AI写代码本质上是Agent(如:CLI / IDE)调用各个厂家的大模型,而这个大模型运行在厂家自有的服务器上。这个过程本来就有成本,所以收费是很正常的。当然某些厂家它提供了免费模型,但是归根到底因为成本存在,所以免费还是不可持续。

这里不打任何广告,只说一下我为什么会用这两家。

首先是Copilot Pro。Copilot Pro能让opencode (一款CLI)接入就已经是一个很大的卖点了,另外你订阅了Copilot Pro就能调用Claude Gemini ChatGPT(御三家),花一分钱享受三家服务,缺点是Claude的上下文窗口比较小,不过应付业余开发肯定是够了。

Gemini就用作网页聊天用,一般负责帮忙改改文件、一起评估下可行性,找点IDEA。当然选Gemini是有原因的,因为能用家庭组拼车,Gemini是御三家里面最便宜的。

真正的用 (OpenCode)

目前谷歌、Claude都不允许OpenCode(及各种第三方软件,如龙虾、反代)调用自己的订阅方案(如Gemini Pro)。违反会面临封号。对此Gemini Pro用户需要使用谷歌自己的Gemini CLI,Claude用户得使用Claude Code。

不过Github的Copilot Pro提供Gemini和Claude的接入,且对OpenCode友好,所以这里讲一下如何接入CopilotPro。

安装OpenCode

目前Opencode比较推荐在linux系统/MAC上安装。另外推荐使用npm去安装(方便更新)。

npm install -g opencode-ai

安装好了,直接在Shell里面输入 opencode 来运行,当然记得要在你的代码库打开shell。

好,看到类似的界面说明你已经用上了opencode。不过我们还需要接入我们的订阅方案,这里介绍一下如何接入copilot pro。

接入Copilot Pro套餐

在输入框中输入 /connect 回车

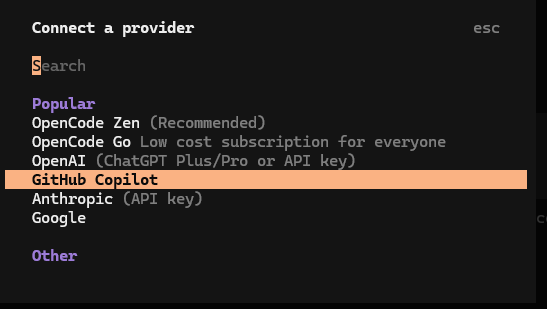

然后我们就能用键盘的光标键选择GitHub Copilot,选中后回车。

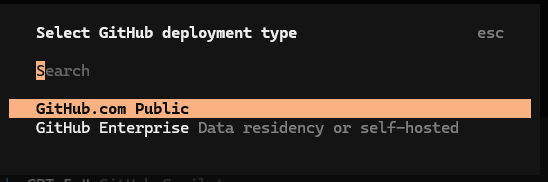

这里看不懂的话第一个就行了。选择后会让你登录github。

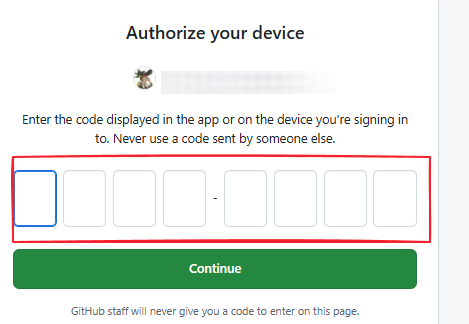

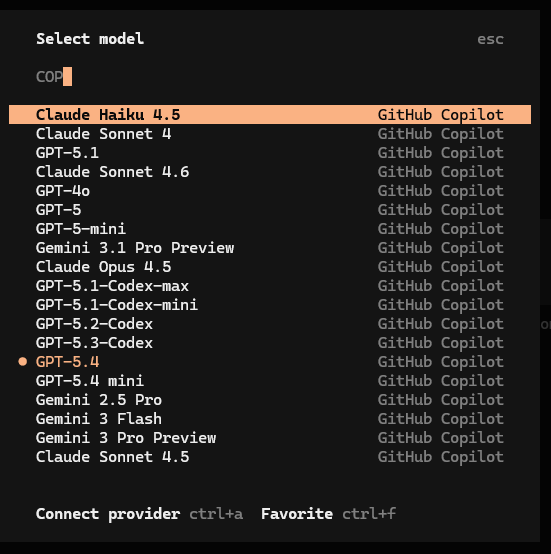

在网页中输入刚刚opencode给出的登录代码,随后就接入了,可以在主界面使用 /models 命令查看模型。

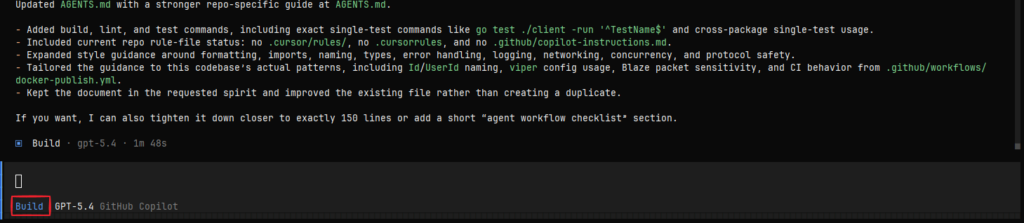

选择需要的模型(截至发稿,比较厉害的有Gemini 3.1 Pro Preview、Claude Sonnet 4.6、GPT-5.4)回车即可。

对话

这个时候第一件事是让LLM生成整个项目的概述,我们可以输入: /init 回车,LLM就会通过Agent把你的整个项目盘一遍,随后生成总结放在AGENTS.md,方便后续使用。

就好像你把项目交接给别人,需要先跟别人大概把项目复盘一遍,这样别人才知道怎么样更好的接手你的项目。

生成好以后,就可以通过对话来指挥LLM替你干活了,在正式开始前要了解OpenCode的一个重要概念:Plan(计划)模式和Build(落地)模式。

Plan模式:此时LLM对你的项目是只读。你给LLM提需求的时候,它会倾向于反复弄清楚你的需求点,弄清楚执行过程中的一些选择,会一直和你提问,要你做决策。直到它给出一个行动大纲,此时你就可以按Tab切换到Build模式

Build模式:此时LLM对你的项目可读可写,会真正开始修改你的代码。

个人经验是:一般对于小一点的,很简单的东西就Build直接改就行。对于一些比较大的,麻烦的事情就先Plan再Build。

Comments NOTHING